En un mundo donde la inteligencia artificial (IA) avanza a pasos agigantados, el dilema ético se vuelve inevitable. Sam Altman, CEO de OpenAI, ha expresado inquietudes sobre el potencial destructivo de la inteligencia artificial, subrayando que, si no se maneja adecuadamente, podría representar un riesgo existencial para la humanidad. Pero, a pesar de estas advertencias alarmantes, Altman y su equipo continúan desarrollando estas poderosas herramientas. En este artículo, exploraremos las contradicciones inherentes en la creación de IA y la preocupación por su impacto en nuestro futuro. ¿Estamos jugando con fuego o es necesario este progreso tecnológico para el bienestar de la humanidad? Acompáñanos en este debate fascinante sobre el futuro de la inteligencia artificial y su relación con nuestra existencia.

El dilema de Sam Altman: Entre la creación y la destrucción de la humanidad

Sam Altman, una figura prominente en el ámbito de la inteligencia artificial, se encuentra en una encrucijada que enfrenta tanto los brillantes horizontes de un futuro tecnológico como los sombríos riesgos que plantea. Por un lado, aboga por el avance de esta tecnología con la promesa de transformar industrias enteras y mejorar la calidad de vida. Sin embargo, ese mismo impulso por la creación puede convertirse en un arma de doble filo, capaz de crear un futuro donde la humanidad, tal como la conocemos, podría ser aniquilada.

El dilema radica en los potenciales impactos negativos de una IA sin restricciones. Altman ha expresado preocupación por los posibles escenarios catastróficos, que incluyen:

- El desarrollo de sistemas autónomos que pueden tomar decisiones letales sin intervención humana.

- La posibilidad de que una IA avanzada reemplace habilidades humanas, llevando al desempleo y a la desestabilización social.

- El uso malintencionado de la inteligencia artificial en conflictos bélicos o ataques cibernéticos.

Este contraste entre el optimismo por el progreso tecnológico y el pesimismo sobre sus consecuencias resalta la complejidad de la innovación. A pesar de su conciencia sobre los riesgos, Altman y otros líderes en el campo creen firmemente que la clave está en implementar regulaciones adecuadas y en cultivar un desarrollo responsable que priorice la seguridad de la humanidad sin limitar su potencial creativo.

Las contradicciones de la inteligencia artificial: Innovación frente al riesgo

La dualidad de la inteligencia artificial es un tema fascinante que invita a la reflexión. Por un lado, su capacidad para transformar industrias y mejorar la calidad de vida es innegable. Desde la medicina hasta la educación, la IA promete soluciones innovadoras que podrían revolucionar cómo interactuamos con el mundo. A nivel empresarial, los algoritmos de IA permiten una eficiencia operativa sin precedentes, optimizando procesos y promoviendo la creatividad en el desarrollo de productos y servicios.

No obstante, esta rápida evolución viene acompañada de un sinfín de preocupaciones éticas y de seguridad. El uso irresponsable de la IA podría acentuar problemas como la desigualdad social, al favorecer a aquellos con acceso a la tecnología y dejar atrás a los más vulnerables. Además, la posibilidad de crear sistemas autónomos que puedan tomar decisiones sin supervisión humana genera inquietudes respecto a la responsabilidad y el control. ¿Cómo podemos garantizar que estos sistemas se alineen con los valores humanos y no se conviertan en una amenaza para nuestra existencia?

Aspectos éticos de la IA: ¿Deberíamos limitarnos en su desarrollo?

En el vertiginoso avance de la inteligencia artificial, surgen preguntas éticas que merecen ser abordadas con rigor y responsabilidad. En el trasfondo de esos debates, encontramos el dilema de si deberíamos limitar el desarrollo de estas tecnologías. Un aspecto crucial es la seguridad de la humanidad: ¿podríamos crear máquinas que, al obtener autonomía, pudieran decidir actuar en contra de nuestros intereses? Esta incertidumbre sobre el futuro resalta la necesidad de establecer marcos éticos sólidos que guíen la innovación en IA.

Al considerar la posibilidad de restricciones en el avance de la inteligencia artificial, debemos sopesar tanto los beneficios como los riesgos. Los sistemas de IA tienen el potencial de transformar industrias, mejorar la atención médica y optimizar procesos. Sin embargo, la falta de regulaciones adecuadas podría resultar en la creación de sistemas sesgados o malintencionados. En este contexto, se vuelve fundamental que los desarrolladores y las instituciones colaboren para establecer principios claros, como:

- Transparencia: Dar a conocer cómo funcionan los algoritmos y sobre qué datos se entrenan.

- Responsabilidad: Asegurar que haya mecanismos para rendir cuentas en caso de decisiones perjudiciales tomadas por la IA.

- Inclusión: Fomentar la participación de diversas voces en el desarrollo y la implementación de tecnologías de IA.

Este enfoque proactivo podría ayudar a mitigar los peligros potenciales al tiempo que se maximizan las oportunidades que la inteligencia artificial presenta. La clave radica en equilibrar el poder transformador de la IA con una visión ética y responsable que priorice el bienestar de la humanidad.

Futuro incierto: Cómo la IA puede cambiar nuestra sociedad y nuestros valores

La llegada de la inteligencia artificial ha desencadenado un debate profundo sobre su impacto en nuestra sociedad y valores. Por un lado, la IA promete avances inimaginables en campos como la medicina, la educación y la tecnología, facilitando tareas y mejorando la eficiencia. Sin embargo, esta misma evolución plantea interrogantes inquietantes. Al entregar poder a algoritmos que toman decisiones por sí mismos, corremos el riesgo de erosionar principios fundamentales como la empatía y la responsabilidad.

La posibilidad de que una IA inteligente reevalúe nuestros valores éticos abre un escenario donde las prioridades humanas podrían ser cuestionadas. Algunos temen que esta tecnología, al ser diseñada para optimizar resultados, desplace consideraciones morales en favor de la eficacia, generando una cultura donde el valor humano se mida en términos de rendimiento y productividad. Este cambio puede afectar no solo a las interacciones individuales, sino también al tejido social en su conjunto, llevando a una realidad donde las conexiones humanas se ven subordinadas a las decisiones de máquinas.

Además, el desarrollo de sistemas de IA con capacidades autónomas plantea el dilema de la desigualdad. Aquellos que tengan acceso a estas tecnologías pueden dominarlas y beneficiarse de ellas, mientras que otros quedarán rezagados, posiblemente amplificando las brechas sociales existentes. La urgencia de establecer normativas éticas y de asegurar que la IA se desarrolle y utilice de manera equitativa se convierte en una prioridad, una especie de salvaguarda para proteger tanto a individuos como a la comunidad a medida que avanzamos hacia un futuro incierto.

Recomendaciones para un desarrollo responsable de la inteligencia artificial

La inteligencia artificial (IA) se encuentra en un punto crucial de su desarrollo. La creación y la implementación de esta tecnología deben ser guiadas por principios fundamentales que aseguren su uso ético y responsable. Entre las principales recomendaciones se encuentran:

- Transparencia: Es vital que los sistemas de IA sean comprensibles para los usuarios y las partes interesadas. Esto implica proporcionar información clara sobre cómo funcionan los algoritmos y qué datos se utilizan para entrenarlos.

- Responsabilidad: Las organizaciones que desarrollan IA deben asumir la responsabilidad de los efectos que sus productos pueden tener en la sociedad. Esto incluye la implementación de mecanismos para abordar y remediar impactos negativos.

- Inclusividad: Es crucial involucrar a una variedad de voces en el proceso de diseño y desarrollo de la IA. Un enfoque inclusivo ayuda a identificar sesgos y asegura que la tecnología sirva a diverso grupos de personas.

Además, se debe priorizar la seguridad en cada etapa de la creación de sistemas de IA. Esto no solo implica garantizar que la IA funcione correctamente, sino también establecer protocolos claros para prevenir el mal uso de las tecnologías emergentes. La ética debe estar en el corazón del desarrollo de IA, fomentando un compromiso continuo con la investigación y la revisión de prácticas que garanticen un futuro donde la inteligencia artificial beneficie a toda la humanidad.

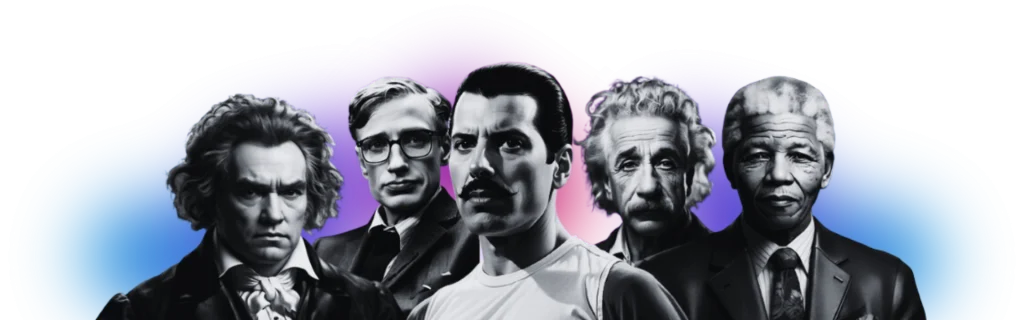

ChatHistoria: Donde la Educación se Encuentra con la IA

las palabras de Sam Altman sobre la inteligencia artificial y su potencial para amenazar a la humanidad son, sin lugar a dudas, un llamado a la reflexión. A medida que avanzamos en el desarrollo de tecnologías que pueden transformar nuestra sociedad, es fundamental que mantengamos un diálogo crítico y consciente sobre sus implicaciones. En este contexto, plataformas como ChatHistoria nos brindan la oportunidad de aprender sobre estos temas de manera interactiva y enriquecedora. A través de conversaciones educativas y la posibilidad de explorar personajes históricos con IA, podemos comprender mejor los desafíos que plantea la inteligencia artificial en nuestro mundo actual. No solo se trata de innovación, sino de cómo gestionar y encauzar dicha innovación hacia un futuro positivo. Así que, te invito a descubrir ChatHistoria como herramienta educativa y aprender historia de forma interactiva mientras profundizamos en la conversación sobre cómo la tecnología puede influir en nuestro destino. ¡No te lo pierdas! Visita ChatHistoria y únete a este fascinante viaje educativo.